Comment l’IA et la sécurité du cloud créent des workflows numériques plus intelligents et plus sûrs en 2026

À mesure que la transformation numérique s’accélère à un rythme soutenu, les entreprises doivent répondre simultanément à deux impératifs : rendre leurs équipes plus efficaces et renforcer leur protection face à des cyberattaques de plus en plus sophistiquées. La convergence entre l’intelligence artificielle (IA) et la sécurité du cloud apporte une réponse convaincante à ce double enjeu. Ensemble, ces deux technologies ne se contentent pas d’améliorer marginalement les processus existants : elles transforment la façon dont les workflows numériques sont conçus, exploités et sécurisés. Résultat : des flux de travail plus intelligents, plus agiles et fondamentalement plus sûrs. linksman En 2026, cette convergence est devenue incontournable, car les workflows dépassent largement les murs du bureau — entre télétravail, outils en ligne et services hébergés aux quatre coins du monde.

L’association IA-cloud n’est pas une simple addition d’outils : c’est une combinaison qui rend possible une défense active, automatisée et contextualisée. Tandis qu’une sécurité conventionnelle, fondée sur des règles fixes, atteint rapidement ses limites face au volume de données et à la vitesse des attaques, l’IA apporte une capacité d’analyse et d’anticipation sans commune mesure. Et comme le cloud donne accès à une puissance de calcul considérable sans investissement matériel, il devient possible de faire tourner des modèles d’IA à grande échelle. On passe ainsi d’une sécurité réactive à une sécurité qui agit de manière anticipée. Adopter des solutions de solution cloud sécurisées constitue d’ailleurs une première étape clé pour construire des workflows numériques résilients.

Définitions clés : IA, sécurité du cloud et workflows numériques

Avant d’examiner les avantages et les usages concrets, il convient de clarifier les fondements. Bien comprendre ce que recouvrent l’IA, la sécurité du cloud et les workflows numériques permet de saisir pourquoi leur association est si puissante.

L’intelligence artificielle appliquée au cloud : définition et enjeux

L’intelligence artificielle (IA) regroupe des systèmes informatiques capables d’accomplir des tâches qui font généralement appel à des capacités cognitives humaines : reconnaissance vocale, génération d’images, détection de motifs ou aide à la prise de décisions complexes. On y distingue notamment :

- Machine Learning (ML) : le système apprend à partir de données d’entraînement pour améliorer ses performances sur une tâche donnée.

- Deep Learning (DL) : une branche du ML qui s’appuie sur des réseaux de neurones artificiels profonds pour identifier des relations complexes dans des données volumineuses, hétérogènes ou incomplètes.

Déployer l’IA dans le cloud consiste à exploiter ces capacités sur une infrastructure cloud public. Le cloud propose des ressources à la demande, ajustables selon les besoins — idéal pour entraîner et exécuter des modèles d’IA gourmands en calcul (notamment sur GPU), sans acquisition de matériel coûteux. Ce modèle a démocratisé l’accès à l’IA, y compris pour les PME et les start-ups, tout en rendant les services cloud plus automatisés et orientés décision.

Sécurité du cloud : principes fondamentaux

La sécurité du cloud englobe les politiques, contrôles et technologies qui protègent les données, applications et infrastructures hébergées dans des environnements cloud. Trois objectifs fondamentaux la structurent :

- Confidentialité — seules les personnes autorisées accèdent aux données,

- Intégrité — les données ne peuvent être modifiées sans autorisation,

- Disponibilité — les services restent accessibles en permanence.

Selon l’IBM Cost of a Data Breach Report, 44 % des entreprises ont déjà subi une violation de données dans le cloud — ce qui fait de la sécurité cloud un enjeu central pour toute organisation.

Les grands axes de la sécurité cloud incluent la gestion des identités et des accès (IAM), le chiffrement des données au repos et en transit, la surveillance continue pour détecter les activités suspectes, la conformité réglementaire (RGPD, AI Act, etc.) et la résilience face aux pannes et aux erreurs. Dans le cloud, le périmètre de sécurité est dynamique : les ressources se créent, se déplacent et disparaissent en permanence. Les menaces peuvent provenir de multiples vecteurs. Une stratégie efficace doit s’adapter rapidement — et c’est précisément là que l’IA apporte une valeur décisive.

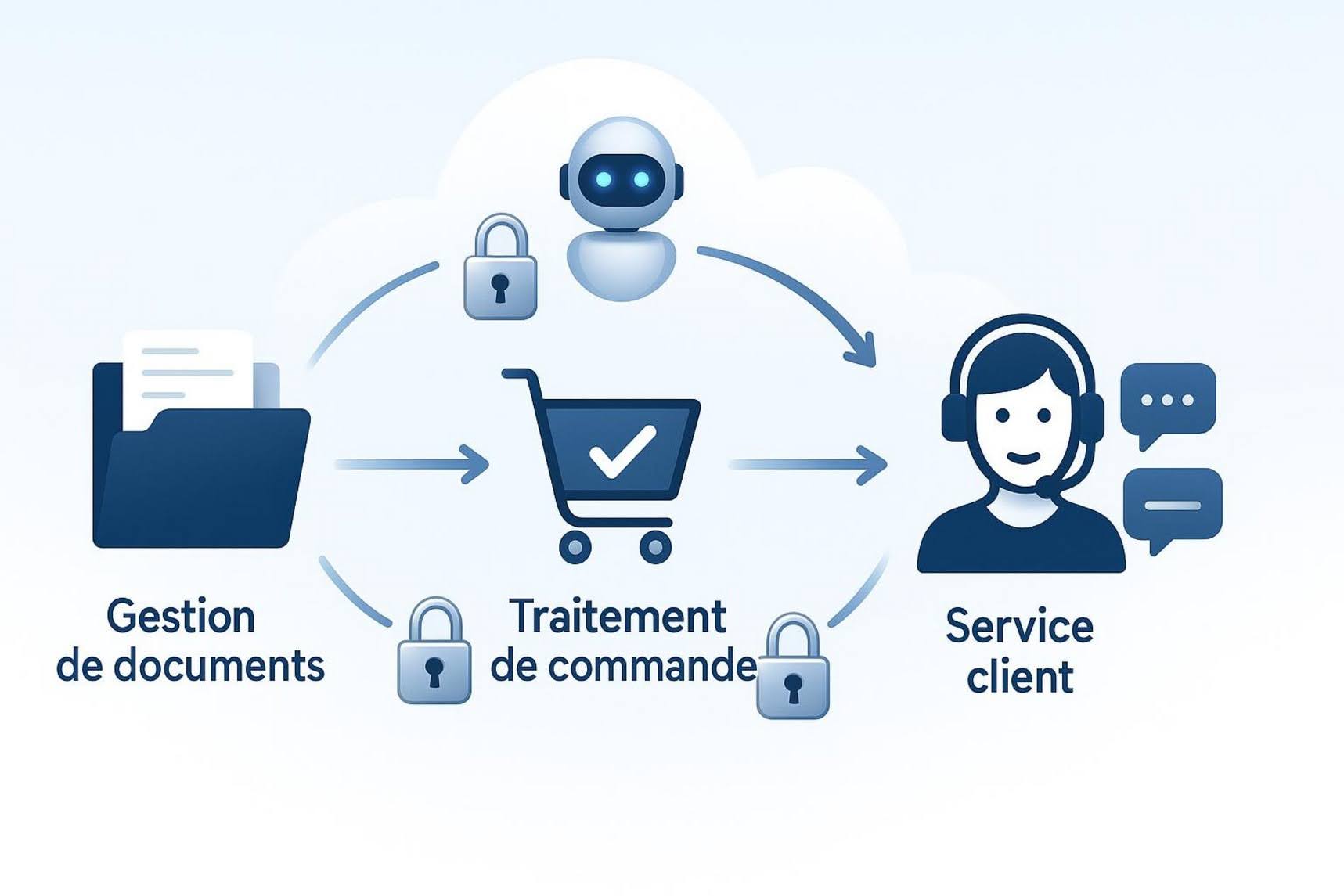

Qu’est-ce qu’un workflow numérique ?

Un workflow numérique (ou flux de travail numérique) est une séquence d’actions — automatisées ou semi-automatisées — qui fait circuler informations et tâches au sein d’une organisation. Ces workflows sont rarement linéaires : ils sont continus, connectés à des outils SaaS, des serveurs et des équipes réparties sur plusieurs sites ou fuseaux horaires. Parmi les exemples les plus courants : gestion documentaire, traitement de commandes, service client, et développement logiciel.

Parce qu’ils sont distribués et véhiculent fréquemment des données sensibles, ces flux sont particulièrement exposés aux risques. Les sécuriser et les optimiser grâce à l’IA et au cloud est devenu un enjeu stratégique pour toute organisation soucieuse de fiabilité et de compétitivité.

Pourquoi associer IA et sécurité du cloud pour des workflows plus intelligents ?

Le rapprochement IA + cloud sécurisé répond à des besoins très concrets : des volumes de données trop importants, des événements trop nombreux et des attaques trop rapides pour être gérés uniquement par des processus humains. Il faut des systèmes capables d’analyser et d’agir en temps quasi réel.

Objectifs de la convergence IA-cloud : de la réaction à l’anticipation

L’objectif fondamental est de passer d’une sécurité qui réagit après coup à une sécurité plus proactive, plus automatisée et contextuellement pertinente. Les environnements modernes sont trop complexes pour des approches basées sur des règles fixes et des interventions manuelles.

Plusieurs facteurs expliquent ce besoin :

- Le volume de données croît de manière exponentielle : le marché mondial du cloud devrait atteindre 2 281 milliards de dollars d’ici 2030, selon les estimations de grands cabinets d’analyse.

- Les attaques gagnent en sophistication et en vitesse d’exécution.

- Le facteur temps est critique : selon des données d’IBM X-Force, un système d’IA intégré au cloud peut ramener la détection d’une menace critique à moins de 15 minutes, contre plusieurs heures pour une analyse purement humaine dans des environnements non instrumentés.

Les objectifs opérationnels sont également : automatiser les tâches répétitives à faible valeur ajoutée, améliorer la qualité de l’analyse de sécurité et permettre une montée en charge fluide des services. Le cloud fournit l’infrastructure et la puissance de calcul ; l’IA apporte la capacité à détecter des anomalies et à traiter de grands volumes en quelques secondes.

Synergies entre IA et cloud sécurisé : vers une sécurité adaptative

Cloud et IA fonctionnent en synergie pour une raison structurelle : l’IA a besoin de données, et le cloud en stocke et en traite d’immenses quantités. Les plateformes cloud servent de socle pour l’entraînement et l’inférence des modèles. En retour, l’IA aide le cloud à mieux se gérer et à mieux se défendre.

Cette collaboration donne naissance à une sécurité adaptative : plutôt que de simplement ériger des barrières, on déploie un système capable de détecter, d’apprendre et de s’ajuster. L’IA peut analyser en temps réel des flux de données et déclencher des réponses automatiques via des plateformes SOAR (Security Orchestration, Automation and Response), notamment :

- bloquer un accès suspect,

- isoler une ressource compromise,

- signaler une chaîne d’événements évocatrice d’une exfiltration.

On obtient ainsi une visibilité plus complète et plus granulaire sur l’environnement cloud — ce qui bénéficie à la fois à la sécurité et aux usages avancés tels que l’IA générative ou l’analyse métier assistée.

Bénéfices concrets de l’IA et de la sécurité cloud pour les workflows numériques

Intégrer l’IA dans la sécurité cloud génère des gains tangibles : efficacité accrue, réduction des risques et meilleure capacité d’évolution.

Automatisation des processus métier et gains de performance

L’IA excelle dans l’automatisation des tâches répétitives et chronophages. Dans un workflow numérique, cela peut se traduire par l’extraction et la classification automatiques de factures, le rapprochement de dépenses et de justificatifs, l’organisation et le tri de documents, ou l’automatisation de certains contrôles en production industrielle.

L’automatisation s’étend également à l’infrastructure cloud : création et ajustement dynamiques des ressources, détection préventive de pannes, et surveillance des indicateurs d’attaque. Ces opérations seraient extrêmement difficiles à conduire manuellement à grande échelle. En les automatisant, l’entreprise réduit ses coûts opérationnels et libère ses équipes pour des tâches à plus forte valeur ajoutée — relation client, arbitrage stratégique, innovation.

Détection proactive des menaces et prévention des incidents de sécurité

L’un des apports les plus significatifs est la capacité de surveillance continue et de détection de signaux faibles. L’IA établit une référence comportementale — qui se connecte, quand, depuis où, pour faire quoi — et signale en temps réel tout écart par rapport à cette norme.

Cela permet de détecter des attaques Zero Day, des menaces internes, et des comportements suspects qui ne correspondent à aucune signature connue. Exemple concret : en analysant des journaux comme CloudTrail ou VPC Flow Logs, l’IA peut corréler plusieurs événements — connexion inhabituelle, modification IAM, accès à un compartiment S3 — et identifier une exfiltration en cours avant qu’elle ne soit consommée.

Par ailleurs, l’IA réduit considérablement la surcharge d’alertes dans les SOC en éliminant jusqu’à 85 % des faux positifs et en attribuant un score de risque contextuel pour aider à la priorisation.

Optimisation de la conformité réglementaire et gouvernance des données

La conformité et la gouvernance des données constituent un défi de taille dans le cloud, car les environnements évoluent rapidement et à grande échelle. L’IA aide en automatisant des contrôles qui seraient autrement très lourds à opérer manuellement. Des outils comme Amazon Macie ou Microsoft Azure Purview peuvent analyser les espaces de stockage pour identifier des données sensibles — numéros de carte bancaire, dossiers médicaux — y compris dans des fichiers non structurés.

L’IA contribue également à prévenir les fuites liées aux grands modèles de langage (LLM) : blocage en temps réel de contenus confidentiels, chiffrement pendant le traitement via l’informatique confidentielle, et règles DLP (Data Loss Prevention) masquant automatiquement les informations sensibles avant affichage. Pour les secteurs soumis à des réglementations strictes, des offres comme Google Sovereign Cloud permettent de conserver le contrôle sur la localisation des données et les clés de chiffrement — un atout majeur pour le respect du RGPD et, désormais, de l’AI Act européen.

Réduction des erreurs humaines et renforcement de la fiabilité

Les erreurs humaines — mauvaise configuration, saisie incorrecte, attribution de droits inappropriés — demeurent l’une des premières causes d’incidents de sécurité. L’IA réduit ce risque en exécutant les tâches de manière constante, sans fatigue ni biais liés au contexte.

Elle apporte également une capacité prédictive : détecter des tendances et des corrélations dans les données pour anticiper des pannes d’infrastructure, des besoins clients ou des goulets d’étranglement logistiques. En cas de menace grave, l’IA peut déclencher des actions de remédiation en quelques secondes — isolation d’une ressource, révocation d’une clé d’accès — ce qui améliore significativement la fiabilité et la résilience globales.

Applications concrètes : comment l’IA renforce la sécurité du cloud dans les workflows

Les bénéfices prennent tout leur sens à travers des cas d’usage réels — surveillance comportementale, gestion d’incidents, protection des données et applications métier sectorielles.

Analyse comportementale et détection d’anomalies dans le cloud

L’IA construit une référence comportementale pour l’ensemble de l’environnement cloud : connexions, appels API, activité des services, comportement des charges de travail. Elle détecte ensuite en temps réel les écarts significatifs : connexion depuis un pays inhabituel, conteneur accédant à des zones non autorisées, ou séquences d’opérations API anormales.

Parce que cette approche ne repose pas uniquement sur des signatures de menaces connues, elle est efficace contre les attaques nouvelles, les vulnérabilités Zero Day et certaines menaces internes. En corrélant plusieurs événements, l’IA peut identifier une exfiltration en cours et offrir une visibilité bien plus précise qu’une surveillance traditionnelle.

Gestion automatisée des incidents et priorisation intelligente des alertes

Les équipes SOC (Security Operations Center) font face à un volume d’alertes souvent ingérable, dont une grande proportion sont des faux positifs. L’IA aide en filtrant ces faux positifs — jusqu’à 85 % — et en attribuant à chaque alerte un score de risque contextuel (criticité de l’actif concerné, probabilité d’exploitation réelle), afin de traiter en priorité les menaces les plus sérieuses.

Elle peut également déclencher des réponses automatisées via des fonctions serverless (AWS Lambda, Google Cloud Functions) : isolation d’une ressource compromise, révocation d’une clé d’accès, blocage d’un utilisateur malveillant. Cela améliore le MTTD (Mean Time To Detect) et le MTTR (Mean Time To Respond), réduisant directement l’impact sur l’activité.

Sécurisation du cycle de vie des données dans le cloud

Les données sont au cœur du cloud et de l’IA — leur protection à toutes les étapes du cycle de vie est donc fondamentale. Des solutions comme Amazon Macie ou Microsoft Azure Purview identifient les données sensibles, même dissimulées dans des documents non structurés. L’IA contribue par ailleurs à prévenir les fuites via les LLM : surveillance des échanges, blocage des contenus confidentiels, chiffrement en cours de traitement (informatique confidentielle) et règles DLP masquant automatiquement les informations sensibles dans les réponses. Google Cloud illustre bien cette tendance en plaçant la sécurisation du cycle de vie des agents IA au cœur de sa stratégie — avec davantage de visibilité, une protection renforcée des données et une réduction proactive des menaces.

Cas d’usage sectoriels : finance, santé, industrie et commerce

La combinaison IA + cloud sécurisé produit des bénéfices concrets dans de nombreux secteurs.

Services financiers — Là où la rapidité et la précision sont critiques : détection de fraude en temps réel sur les flux transactionnels, analyse des risques sur de grands volumes de données, et trading algorithmique basé sur des critères définis et auditables.

Santé — Là où la sensibilité des données est maximale : analyse de données patients pour proposer des traitements personnalisés, aide au diagnostic par imagerie médicale assistée par IA, et accélération de la recherche pharmaceutique (données biomédicales, essais cliniques).

Industrie manufacturière — Là où la continuité de production est stratégique : maintenance prédictive pour détecter les défauts avant la panne, contrôle qualité automatisé, et optimisation de la planification de production via l’analyse combinée de l’historique et des ressources disponibles.

Commerce et e-commerce — Là où le volume et la personnalisation sont déterminants : assistants conversationnels pour gérer les pics de demandes, optimisation de l’agencement en rayon, et détection par caméras IA des articles non scannés aux caisses en libre-service.

Ces cas d’usage se traduisent par des gains mesurables en temps, en coûts, en expérience client — et par une protection significativement renforcée des systèmes.

Défis et limites : quels risques anticiper avec l’IA et la sécurité du cloud ?

Malgré ses atouts considérables, cette approche comporte des limites et des risques qu’il convient d’identifier pour les gérer efficacement.

Dépendance technologique et complexité de la gouvernance IA

La majorité des outils d’IA appliqués à la sécurité émanent des grands fournisseurs cloud. Cela peut engendrer une dépendance forte (vendor lock-in) : changer de prestataire devient difficile car les modèles et les intégrations ne sont pas facilement portables.

La gouvernance se complexifie également : il faut définir des règles d’usage claires, auditer les modèles, suivre l’évolution des réglementations et documenter les décisions automatiques. L’intégration de modèles IA dans des systèmes existants peut par ailleurs exiger des compétences rares et des délais importants.

Biais, hallucinations et risques liés à l’IA générative

L’IA peut se tromper. Les hallucinations — réponses incorrectes présentées avec assurance — peuvent induire des équipes en erreur. Les biais constituent également un problème réel : un modèle entraîné sur des données non représentatives peut signaler à tort des comportements normaux, ou laisser passer des actions dangereuses.

L’IA générative introduit par ailleurs de nouvelles menaces. Selon des données sectorielles récentes, les principales préoccupations des entreprises sont l’exposition de données sensibles (52 %) et les enjeux de conformité réglementaire (50 %). D’autres risques émergents méritent attention : le Shadow AI (outils IA utilisés sans validation préalable), les attaques par injection de prompt, le vol de modèle, les attaques adversariales, et l’empoisonnement des données en cas de gestion insuffisante de l’IAM.

Le risque de fausse confiance et la perte de contrôle humain

Un risque majeur est de s’en remettre excessivement à l’IA. Si les équipes considèrent que « l’IA gère tout », la vigilance baisse — or les attaquants cherchent précisément à tromper les systèmes automatisés. Une décision automatique non supervisée peut laisser une faille ouverte pendant une durée significative.

Le jugement humain reste indispensable pour les cas ambigus, le contexte métier et les décisions à fort impact. Il est essentiel de maintenir une validation humaine — ce qu’on appelle le principe du human-in-the-loop (maintien d’un contrôle humain dans la boucle décisionnelle) — pour toutes les actions aux conséquences significatives. L’IA augmente les capacités des analystes en réduisant les tâches répétitives ; elle ne remplace pas leur discernement.

Coûts et conformité réglementaire continue

Le déploiement d’une IA avancée représente un investissement substantiel : licences, puissance de calcul, et recrutement de profils spécialisés (data scientists, ingénieurs IA, experts cybersécurité). Pour une PME, cette réalité peut accentuer les inégalités de protection face aux grandes organisations.

La conformité est également un effort continu : le RGPD, l’AI Act européen, et les cadres de gouvernance de l’IA (comme le NIST AI Risk Management Framework) évoluent. Il faut documenter, auditer et démontrer que l’usage de l’IA respecte les exigences légales et éthiques en vigueur — ce qui mobilise du temps et des ressources de manière pérenne.

Bonnes pratiques pour intégrer IA et sécurité cloud dans vos workflows numériques

Pour tirer pleinement parti des avantages sans amplifier les risques, une approche structurée est indispensable.

Choisir des solutions cloud et IA certifiées, transparentes et explicables

Commencez par sélectionner des fournisseurs qui placent la sécurité et la transparence au premier plan : contrôles documentés, procédures de reprise après incident, gouvernance des données, et résultats mesurables.

Privilégiez des solutions qui expliquent clairement pourquoi elles font appel à telle méthode d’IA, comment elles évaluent leurs performances, et comment elles restituent leurs détections de manière compréhensible pour les équipes humaines. La explicabilité des modèles (Explainable AI) est une exigence croissante, notamment dans le cadre de l’AI Act européen pour les systèmes à haut risque. Des explications claires accélèrent la réaction des analystes et réduisent les erreurs d’interprétation.

Déployer des stratégies de gestion du risque IA robustes

Adoptez une défense en profondeur couvrant les données, les modèles et les interfaces utilisateurs. Les points clés à mettre en place sont :

- IAM strict avec application du principe du moindre privilège,

- Identité dédiée pour chaque agent IA déployé,

- Politique interne claire sur l’usage des outils IA — qu’ils soient internes ou publics,

- DLP adapté aux échanges avec l’IA : masquage automatique des données personnelles, du code source et des documents sensibles,

- Cadre de gouvernance IA (ex. NIST AI Risk Management Framework) pour encadrer l’ensemble du cycle de vie des modèles.

Former les équipes à la sécurité IA et cloud

Le déficit de compétences est une réalité fréquente. La formation continue doit couvrir les fondamentaux de l’IA (ML/DL) et de la gestion des données, les spécificités du déploiement cloud, les bonnes pratiques de sécurité, et les risques émergents comme le Shadow AI et l’injection de prompt.

Une équipe bien formée détecte mieux les problèmes, réagit plus efficacement aux incidents, et participe activement à la gouvernance des systèmes d’IA.

Surveiller et évaluer en continu l’efficacité des workflows IA sécurisés

Ce type d’intégration n’est pas un projet à durée déterminée : c’est un processus continu. Le suivi doit inclure des outils de découverte pour repérer le Shadow AI et les ressources non autorisées, une surveillance du comportement des modèles en production, des audits réguliers pour détecter biais et hallucinations, et une validation humaine systématique pour les actions à fort impact.

Ce suivi régulier permet d’ajuster la posture de sécurité au fil des nouvelles menaces et de maintenir un environnement fiable et conforme.

FAQ — IA, sécurité du cloud et workflows numériques intelligents

Quels sont les principaux risques de sécurité liés à l’IA dans le cloud ?

Les risques principaux associés à l’IA — en particulier générative — dans le cloud comprennent l’exposition de données sensibles (52 % des entreprises concernées), les enjeux de conformité réglementaire (50 %), le Shadow AI (usage non autorisé d’outils ou de données IA), les attaques par injection de prompt, le vol de modèle et les attaques adversariales, l’empoisonnement des données en cas de gestion IAM insuffisante, et la confiance excessive dans les décisions automatiques sans supervision humaine. Comme les modèles IA traitent de grands volumes de données, une fuite peut avoir un impact particulièrement étendu.

Quelle différence entre sécurité par l’IA et sécurité de l’IA ?

Ces deux notions sont complémentaires et doivent être déployées conjointement :

| Notion | Définition | Exemple concret |

| Sécurité par l’IA | Utiliser l’IA pour améliorer la cybersécurité | Détecter des anomalies réseau, prioriser des alertes, automatiser une réponse via SOAR |

| Sécurité de l’IA | Protéger l’IA elle-même (modèles, données, accès, usage) | Se prémunir contre l’injection de prompt, le vol de modèle, l’empoisonnement des données d’entraînement |

Une approche complète et mature doit adresser les deux dimensions : exploiter l’IA pour sécuriser les environnements, tout en sécurisant les systèmes d’IA eux-mêmes.

Comment éviter les fuites de données lors de l’automatisation des workflows ?

Pour limiter efficacement les fuites, combinez politiques internes et contrôles techniques selon trois niveaux :

- Gouvernance et visibilité

- Politiques claires définissant les outils IA autorisés et les données utilisables

- Détection du Shadow AI : qui utilise quoi, où, avec quelles données

- Contrôles techniques

- Informatique confidentielle : les données restent chiffrées même pendant le traitement

- DLP pour analyser et masquer automatiquement les données personnelles, le code source et les documents sensibles

- Sécurisation des API d’inférence, des déploiements IaC, des données d’entraînement et des poids de modèle

- Souveraineté des données (si requis)

- Maintien des données sensibles dans une zone géographique définie, avec contrôle des clés de chiffrement — indispensable pour le respect du RGPD et des réglementations sectorielles

Quels secteurs bénéficient le plus des workflows numériques intelligents et sécurisés ?

Tous les secteurs peuvent en bénéficier, mais certains y trouvent un intérêt particulièrement marqué en raison de leur volume de données, de leurs besoins d’automatisation et de leurs obligations réglementaires élevées : les services financiers (fraude, gestion des risques, opérations critiques), la santé (données très sensibles, diagnostics assistés, recherche), l’industrie manufacturière (maintenance prédictive, contrôle qualité, production), et le commerce et e-commerce (service client, personnalisation, protection des transactions). En résumé, tout secteur qui doit décider vite, automatiser massivement et protéger des données stratégiques a un intérêt direct et mesurable.

Conclusion

L’association entre l’IA et la sécurité du cloud marque une étape structurante dans l’évolution de l’informatique moderne. Ce n’est pas l’ajout de nouveaux outils à une infrastructure existante : c’est une nouvelle façon de concevoir la gestion des risques numériques et d’organiser le travail. En faisant passer la sécurité d’un mode réactif à un mode proactif et automatisé, cette convergence transforme les workflows numériques et les rend simultanément plus intelligents et plus sûrs.

En investissant dans des approches IA + cloud, les organisations gagnent en agilité et en résilience. Les fournisseurs cloud continuent d’exploiter l’IA pour automatiser et surveiller leurs infrastructures, proposant des services toujours plus avancés — de l’aide à la génération de code à l’analyse de processus métier complexes. Le cloud reste la plateforme la plus accessible pour exploiter l’IA à grande échelle, en fournissant la puissance nécessaire à l’entraînement et à l’exécution de modèles avancés, sans gestion d’infrastructure matérielle en interne.

Les prochaines années verront se déployer davantage d’agents basés sur l’IA générative, capables de prendre en charge des workflows complexes — gestion de la chaîne d’approvisionnement, orchestration de processus métier critiques — avec le cloud comme substrat commun. L’IA occupera une place croissante dans la cybersécurité, non pour remplacer les professionnels, mais pour amplifier leurs capacités. Dans le même temps, l’AI Act européen et les cadres de gouvernance internationaux (NIST AI RMF) imposeront des standards de transparence et d’auditabilité croissants sur les systèmes d’IA déployés dans le cloud.

La réussite dépendra d’un équilibre maîtrisé : exploiter la technologie avec ambition, maintenir un contrôle humain fort — le human-in-the-loop — et garantir que l’innovation progresse dans un cadre sûr, conforme et digne de confiance.